Kunstmatige intelligentie (AI) speelt in vrijwel elk aspect van ons leven een rol, van zelfrijdende auto’s tot slimme stofzuigers, tot computermodellen die het verloop van een epidemie kunnen voorspellen. Hoe geavanceerd deze AI-systemen ook zijn, er blijft altijd een zekere mate van onvoorspelbaarheid bestaan over hun gedrag. Thom Badings ontwikkelde een nieuwe methode om die onzekerheid mee te nemen in voorspellende algoritmes.

‘Veel bestaande methodes kunnen slecht omgaan met die onzekerheid. Er zijn heel veel berekeningen nodig, of ze moeten vanuit bepaalde aannames werken waardoor je de onzekerheid niet goed meeneemt. Onze methode maakt een wiskundig model van die onzekerheid, bijvoorbeeld op basis van historische data, zodat er veel sneller een accurate voorspelling gemaakt kan worden.’

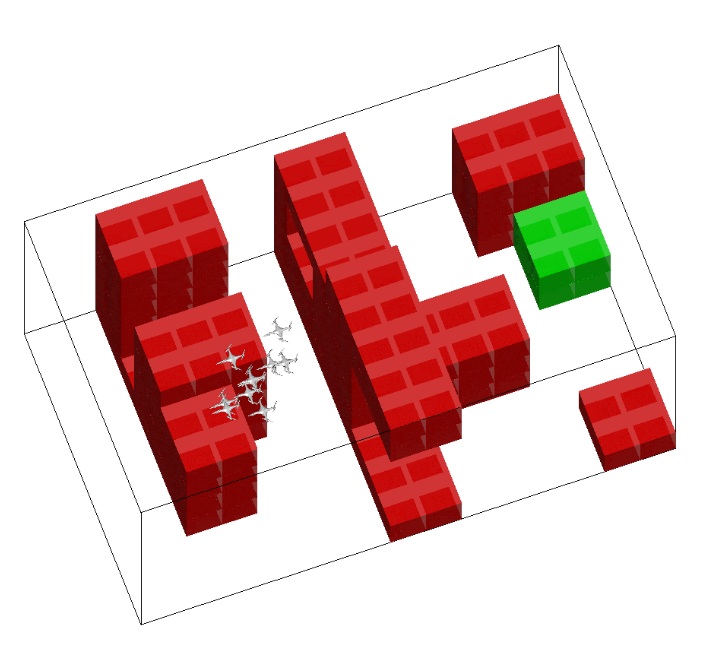

De methode van Badings is gebaseerd op het modelleren van systemen in de vorm van Markov modellen, een bestaande categorie van modellen die vaak gebruikt wordt in de regeltechniek, AI en besliskunde. ‘In een Markov model kunnen we onzekerheid expliciet meenemen in bepaalde parameters, bijvoorbeeld voor de windsnelheid of het gewicht van een drone. Vervolgens plaatsen we het model van de onzekerheid, zoals een kansverdeling over deze parameters, in het Markov model. Met behulp van technieken uit de regeltechniek en de informatica kunnen we vervolgens bewijzen of dit model zich veilig gedraagt, ondanks de zekerheid in het model. Zo kun je een exact antwoord krijgen op bijvoorbeeld de vraag wat de kans is dat je drone tegen een obstakel botst, zonder dat je elk scenario apart hebt hoeven simuleren.’

Lees het hele bericht op de site van de Radboud Universiteit.